늦깎이 공대생의 인공지능 연구실

[해석할 수 있는 기계학습(3)] 데이터셋 본문

기계학습으로 학습을 하기 위해서는 특정한 구조의 데이터셋을 필요로 합니다. 각 데이터셋의 구조는 다르지만 이를 학습하기 위한 딥러닝 기계학습 과정은 크게 다르지 않습니다. 여기서는 다양한 분야에서 생성된 데이터셋들의 일부에 살펴보도록 하겠습니다.

1. 자전거 대여(회귀)

이 데이터셋에는 자전거 대여 회사로부터 당일 빌린 자전거의 대수와 그 날의 날씨 및 계절 정보를 포함하고 있습니다. 이 데이터들을 통해 우리들은 날씨에 따라 자전거 대여수가 얼마나 달라지는지 알아낼 수 있습니다.

자전거의 데이터셋의 구성에 대해 알고 싶으신 분은 아래의 Github 사이트를 통해 확인해주세요

https://github.com/christophM/interpretable-ml-book/blob/master/data/bike.csv

2. 유튜브 스팸 댓글(텍스트 분류)

유튜브는 전세계를 대상으로 구글 계정을 소유한 누구나 동영상을 사람들에게 공유할 수 있는 사이트입니다. 인기동영상일수록 많은 댓글이 달리는데 그 중에는 상대를 비하하거나 광고를 다는 등 해당 동영상의 콘텐츠와는 완전 딴판인 내용들이 상당합니다. 이를 줄이기 위해 유튜브는 다양한 언어의 스팸 댓글들을 필터링 하는데 많은 노력을 하고 있습니다.

유튜브의 스팸필터 데이터셋에 대해 자세히 알아보고 싶으신 분은 아래의 링크를 참고해 주시기 바랍니다. 다만, 아래의 데이터셋은 2015년을 기준으로 만들어진 것이며 현재의 데이터셋과 다를 수 있습니다.

https://github.com/christophM/interpretable-ml-book/blob/master/data/TubeSpam.csv

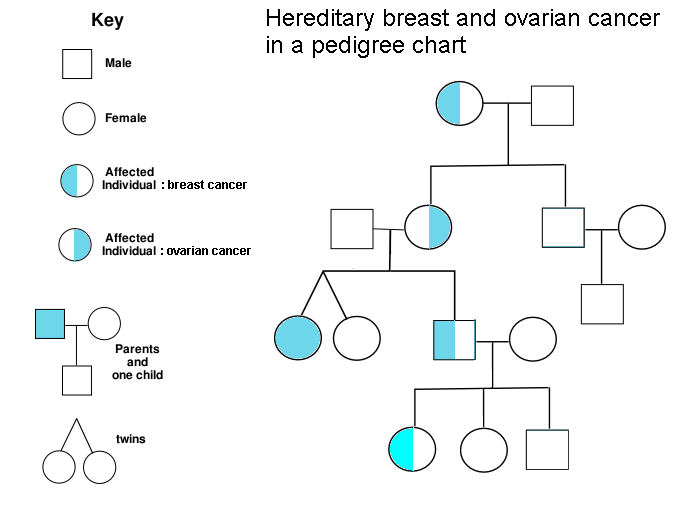

3. 자궁경부암 위험 요소(분류)

자궁경부암의 데이터셋에는 한 여성이 자궁경부암의 위험 요소를 얼마나 갖고 있는지 나타내는 예측 지표가 포함되어 있습니다. 이 데이터에는 인구 통계 데이터(나이), 생활패턴과 병력 등이 포함되어 있습니다.

생체 검사 결과는 자궁경부암을 진단하기 위한 기본지표로서의 역할을 합니다. 여기서는 생체 검사 내용을 타겟으로 사용합니다. 데이터에 비어있는 값의 경우 가장 빈번한 값으로 대치될 수 있는데, 이는 실제 값에 값이 없을 확률과 관련되어 있어 그렇게 좋은 해법은 아닙니다. 사적인 질문이 포함되어 있어 데이터가 다소 편향되어 있을 수도 있습니다.

자궁경부암 위험 여부를 판별하기 위한 모델에 사용되는 데이터셋은 아래의 링크와 같습니다. 궁금하신 분들은 데이터셋의 구조를 참고해주시기 바랍니다.

https://github.com/christophM/interpretable-ml-book/blob/master/data/cervical.csv

참고자료: https://christophm.github.io/interpretable-ml-book/bike-data.html

3.1 Bike Rentals (Regression) | Interpretable Machine Learning

Machine learning algorithms usually operate as black boxes and it is unclear how they derived a certain decision. This book is a guide for practitioners to make machine learning decisions interpretable.

christophm.github.io

https://christophm.github.io/interpretable-ml-book/spam-data.html

3.2 YouTube Spam Comments (Text Classification) | Interpretable Machine Learning

Machine learning algorithms usually operate as black boxes and it is unclear how they derived a certain decision. This book is a guide for practitioners to make machine learning decisions interpretable.

christophm.github.io

https://christophm.github.io/interpretable-ml-book/cervical.html

3.3 Risk Factors for Cervical Cancer (Classification) | Interpretable Machine Learning

Machine learning algorithms usually operate as black boxes and it is unclear how they derived a certain decision. This book is a guide for practitioners to make machine learning decisions interpretable.

christophm.github.io