늦깎이 공대생의 인공지능 연구실

합성 개구경 레이더(SAR) 이미지로 컴퓨터 비전을 사용한 우크라이나 전황 지능 분석 가속화 방법 본문

위성 사진은 현재 러시아의 우크라이나 침공 상황에서 중요한 정보원입니다. 군사 전략가, 언론인, 그리고 연구원들은 위성 사진을 분석하여 결정을 내리고, 국제 협약의 위반을 밝히고, 대중에게 전쟁의 냉엄한 현실을 알리기 위해 이 이미지를 사용합니다. 우크라이나가 많은 양의 구름이 나라를 덮고 있는 것을 경험한데다가, 밤 시간 동안 종종 공격이 발생하면서, 대다수의 위성 사진이 지상을 보는 이러한 요소들에 의해 방해가 됩니다. 합성 개구경 레이더(SAR) 이미지는 두꺼운 구름을 관통하지만 해석하려면 특수 교육이 필요합니다. 이 지루한 작업을 자동화하면 실시간 통찰력을 얻을 수 있지만, 일반적인 RGB 이미지에서 개발된 현재의 컴퓨터 비전 방법은 SAR의 현상학을 제대로 설명하지 못합니다. 이로 인해 이 중요한 촬영장비의 성능이 저하됩니다. SAR에 특화된 방법, 코드베이스, 데이터셋 및 사전 학습된 모델에 대한 접근과 가용성을 개선하면 우크라이나에게 있어 중요한 시기에 정보 기관, 연구원 및 언론인 모두에게 이익이 될 것입니다.

이 글에서는 다운스트림 분류, 의미 분할 및 변경 감지 파이프라인에 대해 RGB와 SAR의 상호 호환 가능한 사용을 할수 있게 하는 기본 방법과 사전 학습된 모델을 제시합니다.

Introduction

우리는 빠르게 변화하는 세상에 살고 있습니다. 자연 재해, 도시 격변, 전쟁, 그리고 지구 표면에 예측할 수 없고 종종 영구적인 흔적을 남기는 모든 종류의 혼란스러운 사건들을 볼 수 있는 세상입니다. 이러한 변화를 이해하는 것은 역사적으로 어려웠습니다. 분석가들은 우리의 새로운 현실을 탐구하기 위해 파견되었고, 그들의 분산된 조사 결과는 종종 잡음을 내며 현실의 진실로 통합되었습니다. 끊임없는 경계 상태를 유지하는 것은 나다르가 처음으로 항공 사진을 찍었을 때부터 스푸트니크 1호의 전파 신호가 전리층을 분석하기 위해 사용되었을 때까지 우리가 그런 생각을 할 수 있었을 때 부터 이는 인류의 목표였습니다.

경계심, 또는 프랑스인들에게 감시는 수 천년 동안 인류 역사의 일부였습니다. 다른 도구와 마찬가지로, 이는 양날의 검이었습니다. 역사적으로 견제와 균형이 없는 감시는 사회에 해로웠습니다. 반대로, 적절하고 책임감 있는 감시는 우리가 과학적이고 인도적인 영역에서 진보를 초래하여 우리의 세계에 대한 깊은 진실을 배울 수 있게 해주었습니다. 오늘날 궤도에 있는 인공위성의 개수와 함께, 환경에 대한 우리의 이해는 거의 매일 갱신됩니다. 우리는 정보가 매우 적었던 것에서 이제는 우리가 의미 있게 지식을 추출할 수 있는 것보다 더 많은 데이터를 가지고 있는 것으로 빠르게 전환해 왔습니다. 이해는 커녕 이러한 정보를 저장하는 것이 더욱 시급한 엔지니어링 과제입니다.

기계학습과 원격 감지

매일 수백 테라바이트의 데이터가 위성에서 데이터 센터로 다운링크되는 상황에서 수동 처리를 통해 해당 데이터에서 지식과 실행 가능한 통찰력을 얻는 것은 이미 불가능한 작업이 되었습니다. 원격 감지 데이터에서 가장 널리 사용되는 형태는 전기 광학(EO) 위성 이미지입니다. EO 이미지는 Google 지도 또는 유사한 매핑 소프트웨어를 사용해 본 사람이라면 누구나 EO 위성 이미지와 상호 작용한 적이 있을 것입니다.

EO 이미지에 대한 기계학(ML)은 다양한 과학 및 상업 응용 분야에서 사용됩니다. 강수량 예측 개선, 북인도 지역의 벽돌 가마 식별을 통한 인간 노예 분석, 교통 경로 개선을 위한 전체 도시 분류에 이르기까지, EO 이미지에 대한 ML의 출력은 인간 사회의 거의 모든 측면에 통합되었습니다.

EO 이미지를 위해 일반적으로 사용되는 위성군(satellite constellation, 서로 동조하며 작동하고 있는 인공위성들의 집합)에는 미국 지질조사국이 운영하는 Landsat 위성 시리즈와 유럽 우주국이 운영하는 Copernicus Sentinel-2 위성군이 있습니다. 이러한 위성군은 10-60m의 해상도로 이미지를 제공하므로 많은 사용 사례에 적합하지만 더 자세한 세부 사항을 관찰할 수 없습니다.

고해상도 상업용 전기-광학 위성 이미지의 등장

지난 몇 년 동안, 초고해상도(VHR) EO 이미지는 다양한 상업적 소스를 통해 이용 가능하게 되었습니다. 0.3~2.0m 사이의 해상도를 보이는 Planet, Maxar, Airbus와 같은 회사들은 매일 지구 전체를 이미지화하면서 높은 재방문율과 함께 매우 정확한 이미지를 제공하고 있습니다.

VHR 이미지에서 제공하는 향상된 해상도로 인해 다운스트림 사용 사례를 다양하게 활용할 수 있습니다. 침식은 더 미세한 규모로 감지될 수 있으며, 건물 피해는 자연재해로 분류할 수 있습니다.

기계학습 방법은 VHR 위성 이미지에 대응하여 적응해야 했습니다. 정확도가 높아짐에 따라, 픽셀의 양과 식별할 수 있는 클래스의 양이 규모 수만큼 증가했습니다. 컴퓨터 비전 연구는 위성 이미지의 효율적인 표현을 배우기 위한 계산 비용을 줄이고, 레이블에 대한 증가된 부담을 완화하기 위한 방법을 만들고, 심지어 컴퓨터 비전 실무자들이 이 풍부한 이미지 소스를 처리할 수 있도록 대형 소프트웨어 프레임워크를 설계하는 것으로 대응했습니다.

일반적으로, 다른 비항공 RGB 이미지에 대한 기존 컴퓨터 비전 방법은 위성 이미지로 매우 전이가 잘 됩니다. 이를 통해 상용 VHR 이미지를 매우 정확한 결과로 즉시 유용하게 사용할 수 있습니다.

전기-광학 이미지의 문제점

전쟁이나 자연 재해와 같이 매우 격동적이고 위험한 상황에서는, 지구에 지속적으로, 신뢰할 수 있는 접근을 하는 것이 가장 중요합니다. 안타깝게도 EO 이미지가 모든 보안 감시 요구를 해결할 수는 없습니다. EO는 낮에만 광원을 감지할 수 있고, 밝혀진 대로, 지구의 거의 3분의 2가 어느 시간에나 구름으로 덮여 있습니다. 구름을 고려하지 않는 한, 지구 표면이 구름으로 막혀있어 지상에서 일어나는 일이 매우 중요하다는 것을 알아야 하는 순간에는 이것이 문제가 됩니다. 기계 학습 방법은 구름이 없는 세상이 어떻게 보일지 예측함으로써 이 문제를 회피하려고 합니다. 그러나 정보의 손실은 근본적으로 복구할 수 없습니다.

합성 개구경 레이더(SAR) 이미지

합성 개구경 레이더(SAR) 이미지는 위성이 마이크로파 레이더 파동의 펄스를 지구 표면으로 전송하는 원격 감지의 활성 형태입니다. 이 레이더 전파는 지상과 그 위에 있는 물체에 반사되어 위성으로 되돌아갑니다. 시간과 공간에 걸쳐 이러한 펄스를 처리함으로써 각 픽셀이 서로 다른 레이더 산란의 중첩인 SAR 이미지가 형성됩니다.

레이더 전파는 구름을 투과하고, 위성은 레이더 전파를 활발하게 생성하기 때문에, 전파는 밤에도 지구의 표면을 비춥니다. 합성 개구경 레이더는 지구의 거칠기를 추정하는 데 사용되며, 넓은 지역의 홍수 범위를 매핑하는 데 사용되며, 보호 수역에서 불법 어선의 존재를 탐지하는 데 사용됩니다.

현재 여러 개의 SAR 위성군이 작동 중입니다. Copernicus Sentinel-1 위성군은 일반 대중에게 10-80미터의 해상도로 이미지를 제공합니다. ICEYE 및 카펠라 스페이스와 같은 대부분의 상업용 SAR 제공업체는 0.5m 해상도로 이미지를 제공합니다. 곧 출시될 다른 상용 공급업체는 위성군이 성장하고 정부 규제가 진화함에 따라 높은 재방문율을 가진 0.5m 이하의 해상도로 SAR 이미지를 제작하는 것을 목표로 하고 있습니다.

합성 개구경 레이더 이미지의 이상한 세계

SAR 이미지는 한눈에 EO 이미지와 매우 유사해 보일 수 있지만, 기본 물리학적 기저는 상당히 다르며, 이는 이미지 제품에 많은 흥미로운 효과를 초래하여 현대의 컴퓨터 비전과 호환되지 않을 수 있습니다. 세 가지 일반적인 효과는 편광 효과, 레이오버 효과 및 다중 경로 효과라고 합니다.

SAR 위성의 레이더 안테나는 편광 레이더파를 전송하는 경우가 많습니다. 편광의 방향은 파장의 방향입니다. 지상의 물체는 레이더 파장의 다른 편광에 대해 서로 다른 반응을 보입니다. 따라서 SAR 위성은 종종 수평(H) 또는 수직(V) 편광파를 중계하고 편광파를 다시 읽어 HH, HV, VH 및 VV 대역을 생성하는 이중 또는 4중 편광파 모드로 작동합니다. EO 이미지에서 RGB 대역과 대조할 수 있지만, 기본 물리학은 다릅니다.

레이오버 효과는 레이더 빔이 하단에 도달하기 전에 구조물의 상단에 도달하여 물체의 상단이 하단과 겹치는 형태로 나타나는 효과입니다. 이것은 물체가 특히 높을 때 발생합니다. 시각적으로, 높은 건물들은 옆으로 누워 있는 것처럼 보이고, 산은 봉우리들이 바닥과 교차하는 것처럼 보일것입니다.

다중 경로 효과는 레이더 파장이 지상의 물체에 반사되어 SAR 센서로 돌아가기 전에 여러 번 산란이 발생합니다. 다중 경로 효과로 인해 물체는 결과 이미지의 다양한 변환으로 이미지에 나타납니다. 이러한 효과는 SAR 이미지에서 어디서나 볼 수 있지만, 도시 지역, 숲 및 기타 밀집된 환경에서 특히 두드러집니다.

기존의 RGB 이미지를 기반으로 하는 기존의 컴퓨터 비전 방법은 이러한 효과를 염두에 두고 구축되지 않습니다. EO 위성 이미지에 대해 학습된 물체 감지기는 고유한 물체가 한 번만 나타나거나, 물체가 잠재적으로 미러링되거나 흩어지거나 주변 물체와 서로 얽혀 있는 것이 아니라 다른 맥락에서 상대적으로 유사하게 나타날 것이라고 가정합니다. EO 이미지에서 폐색의 바로 그 본질과 폐색의 가정에 바탕을 둔 비전 원칙은 SAR로 바뀌지 않습니다. 이를 종합하면 기존 컴퓨터 비전 기술은 SAR 이미지로 전송할 수 있지만 성능이 저하되고 SAR별 방법론을 통해 해결할 수 있는 일련의 체계적인 오류가 발생합니다.

우크라이나를 위한 SAR 이미지 컴퓨터 비전

이미지 분석가는 현재 우크라이나에서 사용할 수 있는 EO 및 SAR 이미지에 모두 의존하고 있습니다. EO 이미지를 사용할 수 있는 경우 해당 촬영장비를 위해 구축된 기존 컴퓨터 비전 도구를 사용하여 지능 수집 프로세스를 가속화합니다. 그러나 SAR 이미지만 사용할 수 있는 경우에는 이러한 도구 체인을 사용할 수 없습니다. 이미지 분석가는 시간이 많이 걸리고 실수하기 쉬운 수동 분석에 의존해야 합니다. 이 주제는 국제적으로 몇몇 다른 기관들에 의해 연구되고 있지만, 이용 가능한 데이터의 양에 관해서는 여전히 연구가 덜 된 분야입니다.

Berkeley AI Research에서는 공개된 BigEarthNet-MM 데이터셋과 RGB 및 SAR 이미지로 구성된 카펠라의 오픈 데이터에서 RGB, SAR 및 공동 등록된 RGB + SAR 이미지에 대한 강력한 표현을 학습한 초기 방법과 모델을 만들었습니다. 따라서 이 모델을 사용하여 이미지 분석가는 이미지 분류, 의미 분할, 객체 감지 또는 변경 감지와 같은 다운스트림 작업에 RGB, SAR 또는 공동 등록된 RGB+SAR 이미지를 상호 교환하여 사용할 수 있습니다.

SAR이 EO 이미지와 현상학적으로 다른 데이터 소스임을 감안할 때, 비전 트랜스포머(ViT)는 컨볼루션 신경망에 내장된 스케일을 제거하고 불변 유도 bias를 이동시키기 때문에 SAR을 이용한 표현 학습에 특히 효과적인 아키텍처라는 것을 발견했습니다. RGB, SAR 및 공동 등록된 RGB + SAR에 대한 표현 학습을 위한 최고의 수행 방법인 MAERS는 Kaiming HE 등이 최근에 도입한 MAE(Masked Autoencoder)를 기반으로 합니다. 여기서 신경망은 데이터의 마스크 버전을 입력으로 취하고 데이터를 인코딩한 다음 이러한 방식으로 데이터를 디코딩하는 방법을 학습합니다. 이와 같은 방식으로 이 모델은 마스크되지 않은 입력 데이터를 재구성합니다.

인기 있는 대조 학습 기술 클래스와는 달리 MAE는 SAR 특성에 대해 부정확할 수 있는 데이터의 특정 증강 불변성을 전제로 하지 않습니다. 대신 RGB, SAR 또는 공동 등록된 양식에 구애받지 않는 원본 입력을 재구성하는 데만 의존합니다. 아래 그림과 같이 MAERS는 RGB, SAR 및 RGB+SAR 채널에 대한 독립적인 입력 투영 계층을 학습하고, 공유 ViT를 사용하여 이러한 투영 계층의 출력을 인코딩한 다음, 독립적인 출력 투영 계층을 사용하여 RGB, SAR 또는 RGB+SAR 채널에 디코딩하여 MAE를 더욱 확장합니다. 그런 다음 입력 투영 계층과 공유 ViT를 객체 감지 또는 변경 감지와 같은 다운스트림 작업으로 전송할 수 있으며, 여기서 입력 인코더는 RGB, SAR 또는 RGB+SAR를 입력으로 사용할 수 있습니다.

RGB, SAR 및 공동 등록된 양식에 대한 표현을 학습하면 콘텐츠 기반 이미지 검색, 분류, 분할 및 감지와 같은 다양한 다운스트림 작업에 도움이 될 수 있습니다. 학습된 표현의 효과를 입증하기 위해, 우리는 1) BigEarthNet-MM 데이터셋에서 공동 등록된 EO 및 SAR 장면의 다중 레이블 분류, 2) VHR EO 및 SAR SpaceNet 6 데이터셋에서 의미 분할(Sementic Segmentation)이 잘 확립된 벤치마크에 대한 실험을 수행합니다.

MAERS는 ViT 기반 인코더에 대한 ImageNet 가중치를 사용하여 초기화된 다음 RGB, SAR 및 RGB+SAR 이미지를 사용하여 20번의 epoch 동안 BigEarthNet-MM 데이터셋에 대한 사전 학습을 수행합니다. 우리는 MAERS 인코더에 단일 선형 레이어를 추가하고 전체 모델을 20 epoch동안 미세 조정하여 다중 레이블 분류 작업을 학습합니다(선형 탐색 실험은 향후 논문에서 보여질 것처럼 유사한 결과를 얻을 수 있습니다). 이 결과는 아래의 표에 나와 있습니다. 미세 조정이 있는 MAERS는 BigEarthNet-MM 논문에서 제시된 최고의 RGB+SAR 결과를 능가하며, RGB, SAR 및 RGB+SAR 입력 양식에 대한 표현 학습을 위해 최첨단 MAE 아키텍처를 적용하면 최첨단 결과가 도출된다는 것을 나타냅니다.

VHR EO 및 SAR SpaceNet 6에서 의미 분할(Semantic Segmentation) 수행

버클리 AI랩은 또한 우크라이나에서의 파괴를 이해하는 것을 목표로 하는 이미지 분석가들에게 도움이 되는 시기적절한 작업에 대한 이전 학습을 실험했습니다. 즉, 건물 손상 평가를 수행하기 위한 사전 작업인 건물 흔적의 의미 분할입니다. 건물 피해 평가는 인프라와 민간인에 대한 러시아의 공격의 범위와 심각성을 이해하는 것을 목표로 하는 정부 관리, 언론인 및 인권 단체들에게 직접적으로 필요한 관심사입니다.

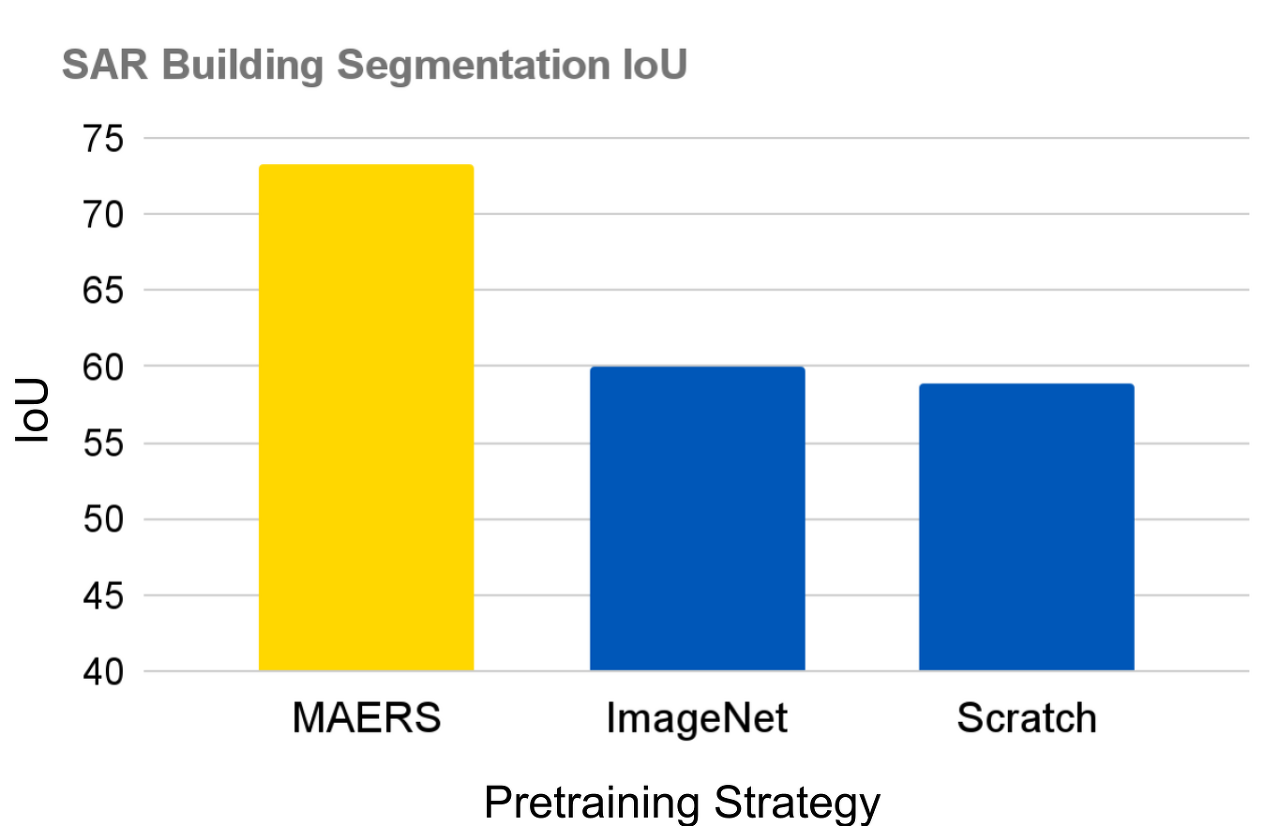

이 실험을 위해, SpaceNet 6 데이터셋을 공개 벤치마크로 사용하여 카펠라 스페이스의 VHR SAR로 건물 흔적 감지를 위한 학습된 표현의 효과를 설명했습니다. 우리는 의미 분할을 위해 이 인코더를 UperNet 아키텍처와 함께 사용했습니다. 아래의 그래프는 SAR 또는 RGB 이미지를 사용하도록 훈련된 분할 모델에서 SAR 입력 이미지만 있는 SpaceNet 6의 보류된 검증 구성 요소에서 건물 흔적을 분할하는 IoU 성능을 보여줍니다. MAERS 사전 학습된 모델은 RGB+SAR 모델을 처음부터 학습하거나 ImageNet 가중치를 정확히 동일한 아키텍처로 조정하는 것에 비해 최대 13점 이상 향상된 것을 볼 수 있습니다.

이를 통해 MAERS는 실무자가 EO 또는 SAR 이미지를 상호 교환하여 다운스트림 작업을 수행할 수 있도록 하는 강력한 RGB+SAR 표현을 학습할 수 있음을 보여줍니다. SAR 이미지의 현상학은 건물 분할에 완전히 도움이 되지 않으며, 이 작업에 EO 이미지를 사용하면 IoU 점수가 90 이상이 된다는 점에 유의해야 합니다. 이는 아직 SAR 기법에 의해 다뤄지지 않은 상당한 격차를 남겨두고 있으며, 이는 다음 논문에서 다루려고 합니다. 그러나 환경 조건이 EO 이미지 캡처에 도움이 되지 않을 때는 SAR에서 이 성능을 제거하는 것이 필수적이다.

이러한 결과는 예비적이지만 설득력이 있습니다. 자세한 실험과 벤치마크를 포함한 논문 발표를 통해 이러한 노력을 계속해 나갈 것입니다. 또한, 인도주의 파트너들에게 모델을 전환하여 그들이 주거지역과 다른 민간지역에 대한 변화 탐지를 수행하여 우크라이나에서 벌어지고 있는 전쟁범죄를 더 잘 추적할 수 있도록 지원할 것입니다.

이 모델들은 우크라이나에서의 전쟁을 주시하고 있는 인도주의적 임무에 관여하는 단체들의 효율성을 증가시키기 위한 목적으로 만들어졌습니다. 하지만, 다른 기술과 마찬가지로, 이 기술이 어떻게 잘못 사용될 수 있는지를 이해하는 것은 우리들의 책임입니다. 그렇기에, 인도적 환경에서 지능 및 이미지 분석을 수행하는 파트너의 의견을 바탕으로 이러한 모델을 설계했습니다. 그들의 생각, 논평, 비판을 고려하여, 우리는 인류의 이익과 그들의 안전하고 책임감 있는 사용을 지시하는 프로세스와 함께 사용될 것이라고 확신하는 기능을 공개합니다.

Call to Action

우리가 살고 있는 복잡하고, 혼란스럽고, 반직관적인 세상을 이해하도록 돕는 기술을 개발하는 자유 민주주의 국가의 시민으로서, 우리는 불의의 행위가 발생했을 때 행동할 책임이 있습니다. 우크라이나의 동료들과 친구들은 극심한 불확실성과 위험에 직면해 있습니다. 우리는 러시아군에 대항하는 데 도움을 줄 수 있는 사이버 영역의 기술을 보유하고 있습니다. 우리의 시간과 노력을 집중함으로써, 그것이 목표적인 연구를 통해서든, 또는 국경을 넘을 때 도움을 받기 위해 처리 시간을 추적하는 것을 돕는 데 우리의 시간을 자원해서든, 우리는 다른 어려운 상황에서 작은 탈출구를 만들 수 있습니다.

우리는 우리의 동료 컴퓨터 과학자들에게 정부 및 인도주의 단체와 협력하고 어려운 시기가 지속될 때 그들의 요구를 들어줄 것을 촉구합니다. 단순한 행동이 큰 차이를 만들 수 있습니다.

Model and Weights

이 모델들은 현재 공개적으로 액세스할 수 없습니다. 이 양식을 통해 자격을 갖춘 연구원들과 파트너들에게 이 모델을 공개하고 있습니다. 모델에 대한 철저한 평가가 완료되면 완전한 배포가 뒤따를 것입니다.

Acknowledgements

Thank you to Gen. Steve Butow and Dr. Nirav Patel at the Department of Defense’s Defense Innovation Unit for reviewing this post and providing their expertise on the future of commercial SAR constellations.

원문 읽기: https://bair.berkeley.edu/blog/2022/03/21/ukraine-sar-maers/

Accelerating Ukraine Intelligence Analysis with Computer Vision on Synthetic Aperture Radar Imagery

The BAIR Blog

bair.berkeley.edu

'BAIR' 카테고리의 다른 글

| [논문프리뷰] 인공증강지능을 위해 HITL(Human-in-the-Loop)을 다시 생각하다 (0) | 2022.07.10 |

|---|---|

| 사회에 도움을 주는 강화학습 시스템 설계 (0) | 2022.06.27 |

| [논문 프리뷰]비지도 강화학습 밴치마크(The Unsupervised Reinforcement Learning Benchmark) (0) | 2022.01.10 |

| [논문 요약] AI 안전에 관한 구체적인 문제들(Concrete Problems in AI Safety) (0) | 2021.12.03 |

| [논문 프리뷰] 기계학습 안전에서 해결되지 않은 문제점들(Unsolved Problems in ML Safety) (0) | 2021.11.27 |